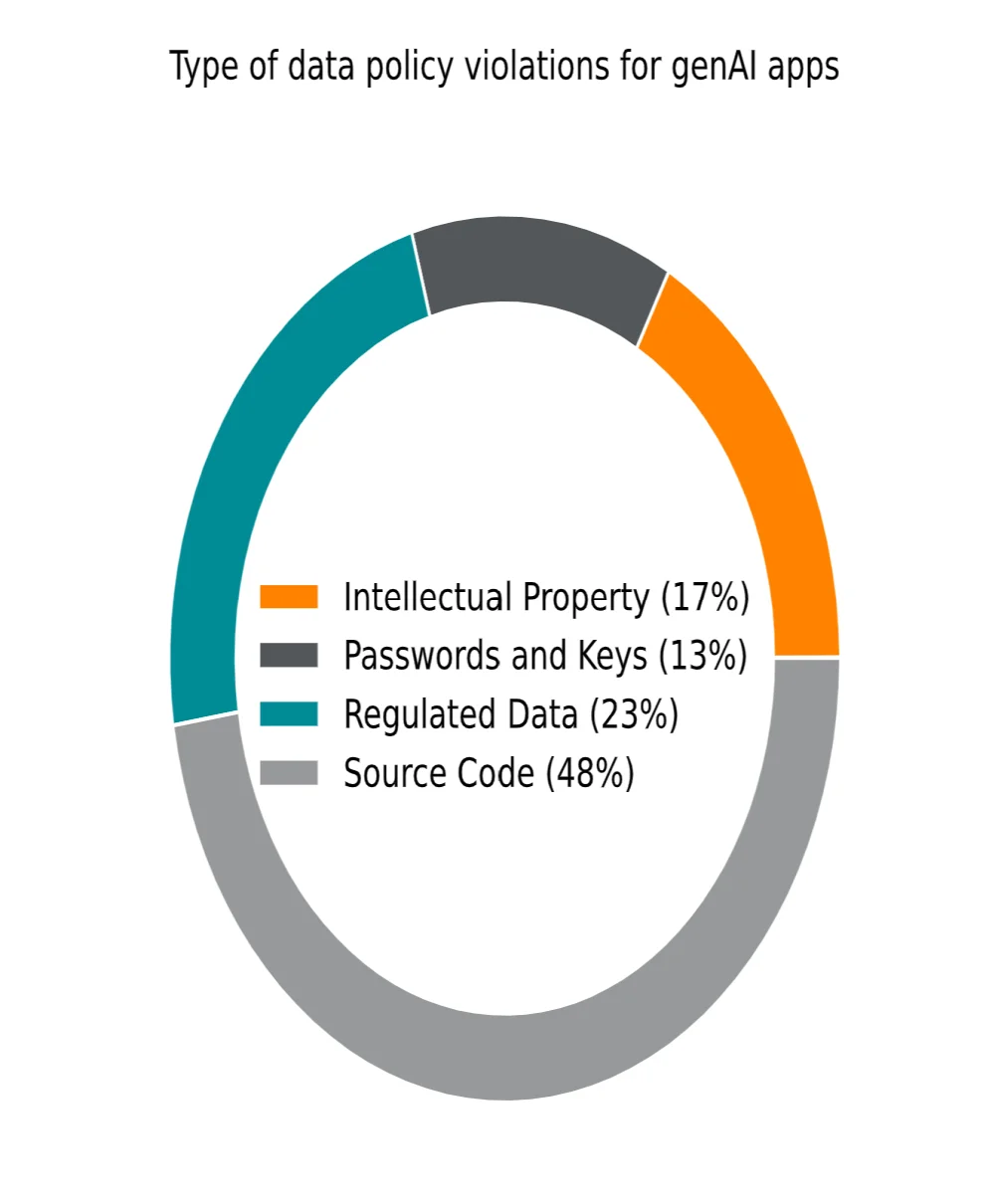

L'adoption croissante de la GenAI redéfinit le paysage technologique des entreprises, en leur offrant des gains de productivité significatifs tout en amplifiant les risques en matière de cybersécurité et de gestion des données. Selon le rapport 2025 Generative AI Cloud and Threat Report de Netskope, un leader de la sécurité et la mise en réseau, le volume de données partagées avec des applications d'IA générative a été multiplié par 30 en un an, incluant des éléments sensibles tels que le code source, les données réglementées, les mots de passe ou les clés de chiffrement. Cette transformation impose aux organisations une réévaluation de leurs stratégies de sécurité afin de préserver l'intégrité et la confidentialité de leurs informations critiques.

En 2023, l'IA générative était encore une technologie émergente, dominée par ChatGPT et Gemini de Google. Seul 1 utilisateur d'entreprise sur 100 accédait à ces outils. En 2025, cette proportion a considérablement augmenté : près d'un utilisateur sur 20 exploite directement des applications GenAI, tandis que la majorité en bénéficie indirectement grâce à leur intégration dans diverses solutions professionnelles. Netskope a recensé 317 applications distinctes de GenAI utilisées par plus de 3 500 de ses clients, confirmant ainsi la généralisation de ces outils dans les flux de travail modernes.

Ray Canzanese, Netskope Threat Labs Director, souligne :

"Les données les plus récentes montrent que l’IA générative n’est plus une technologie de niche, mais qu’elle est omniprésente. Elle s’intègre de façon croissante à tous les domaines, qu’il s’agisse d’applications dédiées ou d’intégrations de back-end. Une telle ubiquité représente un défi croissant pour la cybersécurité ."

Des risques accrus pour la sécurité des données

Cette adoption massive s'accompagne de risques significatifs. Les entreprises voient leurs données confidentielles potentiellement exposées à des applications tierces qui pourraient les exploiter pour entraîner de nouveaux modèles d'IA. Par ailleurs, l'IA générative alimente le shadow IT : 72 % des utilisateurs de la GenAI en entreprise accèdent à ces outils à partir de comptes personnels non sécurisés, échappant ainsi au contrôle des départements informatiques.

Crédit image Netskope

En parallèle, la montée en puissance des infrastructures d’IA en mode local, qui sont passées de moins de 1 % à 54 % en un an, limite certains risques liés au cloud mais introduit de nouveaux défis, notamment des fuites de données internes au sein des chaînes d’approvisionnement et des vulnérabilités

James Robinson, CISO de Netskope, commente :

"Malgré les sérieux efforts accomplis par les entreprises pour mettre en œuvre des outils d’IA générative gérés en interne, notre étude montre que le shadow IT a été remplacé par une IA fantôme, près de trois quarts des utilisateurs continuant d’accéder à des applications d’IA générative à partir de leurs comptes personnels. Cette tendance continue, associée aux données qui sont partagées, souligne la nécessité de mettre en œuvre des moyens de sécurité des données avancés, pour permettre aux équipes en charge de la sécurité et de la gestion des risques de recouvrer gouvernance et visibilité, deux éléments indispensables, ainsi qu’une maîtrise acceptable de la manière dont l’IA générative est employée au sein de leur société."

Stratégies de réduction des risques

Face à ces menaces, près de 100 % des entreprises s’efforcent de réduire les risques liés à l’IA. Parmi les mesures adoptées, Netskope rapporte :

-

Le blocage et la restriction d'accès : de nombreuses organisations préfèrent interdire l'accès aux applications genAI jusqu'à ce qu'une évaluation approfondie soit effectuée ;

-

La prévention des pertes de données (DLP) : des solutions de surveillance et de filtrage sont mises en place pour empêcher le partage involontaire de données sensibles avec des outils d'IA ;

-

Le coaching des utilisateurs en temps réel : des formations et des alertes contextuelles permettent de sensibiliser les employés aux risques et de les guider vers de meilleures pratiques d'utilisation.

Les recommandations de Netskope

Alors que les cybercriminels exploitent l'IA générative pour développer des menaces de plus en plus sophistiquées, les entreprises doivent également évoluer. Comme le souligne Ari Giguere, vice-président de Netskope, une cybersécurité efficace doit allier créativité humaine et puissance technologique pour suivre le rythme de l'innovation. L'adoption de cadres spécifiques et de systèmes de sécurité avancés permet non seulement de réduire les risques, mais aussi de tirer parti des nombreux avantages qu'offre l'IA générative.

Pour protéger les données, les utilisateurs et les réseaux, Netskope préconise de mettre en place une approche structurée :

-

Évaluer le paysage d’IA générative : Identifier les applications et infrastructures GenAI utilisées, ainsi que leurs utilisateurs et leurs usages ;

-

Renforcer le contrôle des applications genAI : Autoriser uniquement les applications validées, bloquer celles non approuvées et utiliser des technologies de prévention des pertes de données (DLP) pour éviter toute fuite d’informations sensibles ;

-

Optimiser les contrôles locaux : Appliquer les cadres de référence tels que le Top 10 des applications LLM de l’OWASP, le cadre de gestion des risques de l’IA du NIST et le référentiel Atlas MITRE pour garantir une protection efficace des infrastructures internes.

: