À l'occasion du premier anniversaire du modèle Mistral 7B, Mistral AI a présenté hier une nouvelle famille de modèles, qu'il appelle "Les Ministraux" : Ministral 3B et Ministral 8B. Ces deux modèles conçus pour être exécutés sur des appareils périphériques, tels que les smartphones ou ordinateurs portables, offrent des performances inédites dans la catégorie des modèles IA de moins de 10 milliards de paramètres, répondant aux besoins croissants en matière d’efficacité, de calcul local et de protection de la vie privée.

Les Ministraux disposent tous deux d'une fenêtre contextuelle pouvant aller jusqu'à 128 000 jetons, Ministral 8B bénéficie, quant à lui, d'une architecture d’attention optimisée pour une inférence plus rapide et économe en mémoire. Selon Mistral AI, ils établissent une nouvelle frontière en matière de connaissance, de bon sens, de raisonnement, d’appel de fonction et d’efficacité dans la catégorie.

Dans son communiqué, la licorne déclare :

"Nos clients et partenaires les plus innovants demandent de plus en plus d’inférence locale et respectueuse de la vie privée pour des applications critiques telles que la traduction sur l’appareil, les assistants intelligents sans Internet, l’analyse locale et la robotique autonome. Les Ministraux ont été conçus pour fournir une solution efficace en calcul et à faible latence pour ces scénarios. Qu’il s’agisse d’amateurs indépendants ou d’équipes de fabrication mondiales, les Ministraux répondent à une grande variété de cas d’utilisation".

Utilisés en combinaison avec des modèles de plus grande envergure comme Mistral Large, les Ministraux jouent le rôle d'intermédiaires efficaces pour l’exécution de tâches complexes, comme les appels de fonction dans les flux de travail en plusieurs étapes.Comparaisons de performances

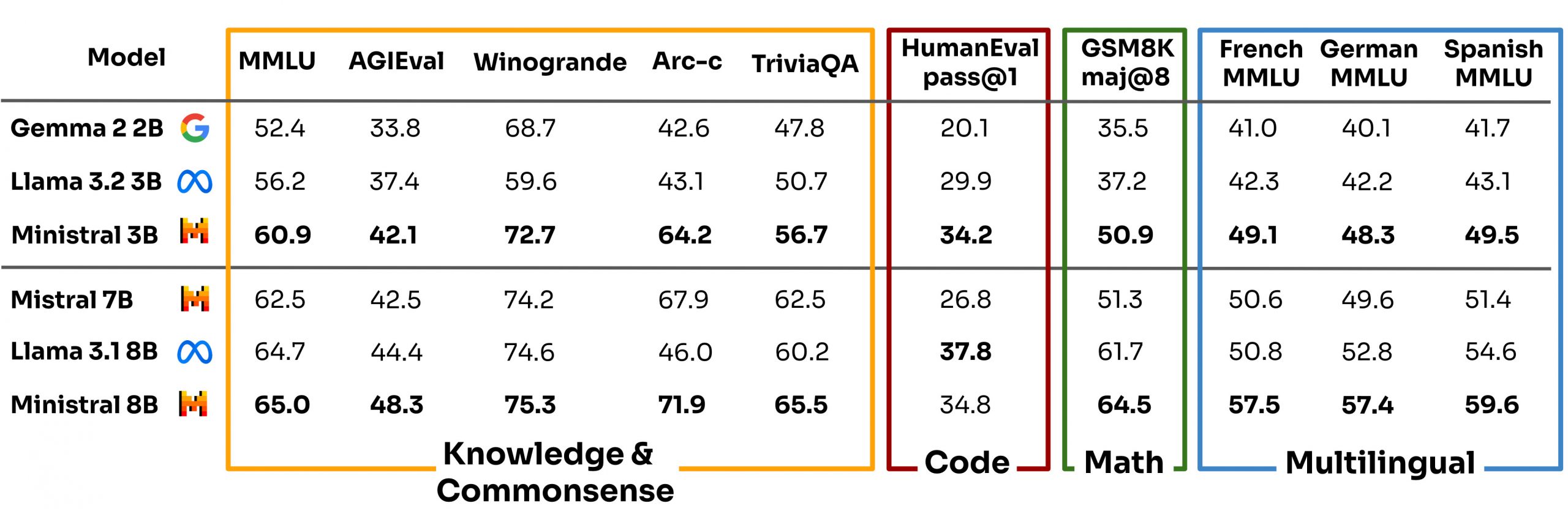

Les Ministraux ont été testés sur diverses tâches où ils ont obtenu de meilleurs résultats que leurs pairs : Gemma 2 2B, Llama 3.2 3B, Llama 3.1 8B et Mistral 7B. Mistral AI précise que tous les modèles ont été réévalués à l’aide de son cadre interne à des fins de comparaison équitable.Modèles pré-entraînés

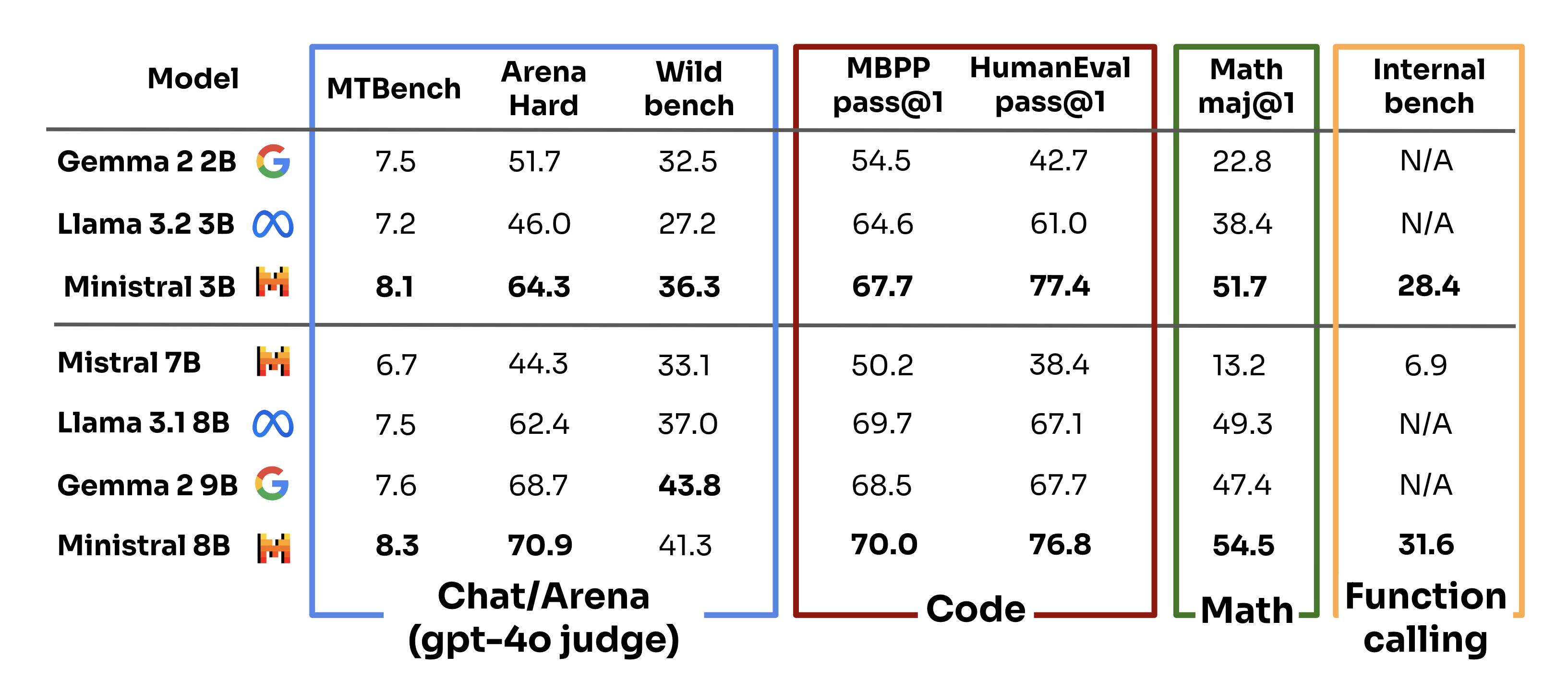

Les modèles Ministral 3B et 8B Instruct ont également été comparés à Gemma 2 2B, Llama 3.2 3B, Llama 3.1 8B, Gemma 2 9B et Mistral 7B sur différentes catégories d’évaluation.

Disponibilité et tarification

Les deux modèles sont d'ores et déjà disponibles sous la licence commerciale Mistral, Ministral 8B peut être téléchargé mais seulement à des fins de recherche.Les développeurs peuvent utiliser Ministral 3B et Ministral 8B via la plate-forme cloud de Mistral AI, La Plateforme, et prochainement sur d’autres clouds partenaires.

Ministral 8B est tarifé à 0,1 dollar par million de jetons de sortie/entrée, tandis que le Ministral 3B revient à 0,04 dollar par million de jetons de sortie/entrée.