Google a pris initialement du retard dans la course à la GenAI, craignant que sa réputation ne soit entachée par une IA générative aux déclarations trompeuses, biaisées ou toxiques. Depuis, il a mis les bouchées doubles avec Bard, PaLM 2, les modèles Gemini et les modèles ouverts de la famille Gemma publiée avec des conditions d’utilisation qui visent à promouvoir une utilisation responsable et à éviter les abus. L'entreprise poursuit sa stratégie d'IA responsable avec l'introduction de Gemma 2 2B, ShieldGemma et Gemma Scope.

Gemma 2 : la nouvelle référence de l'IA ouverte

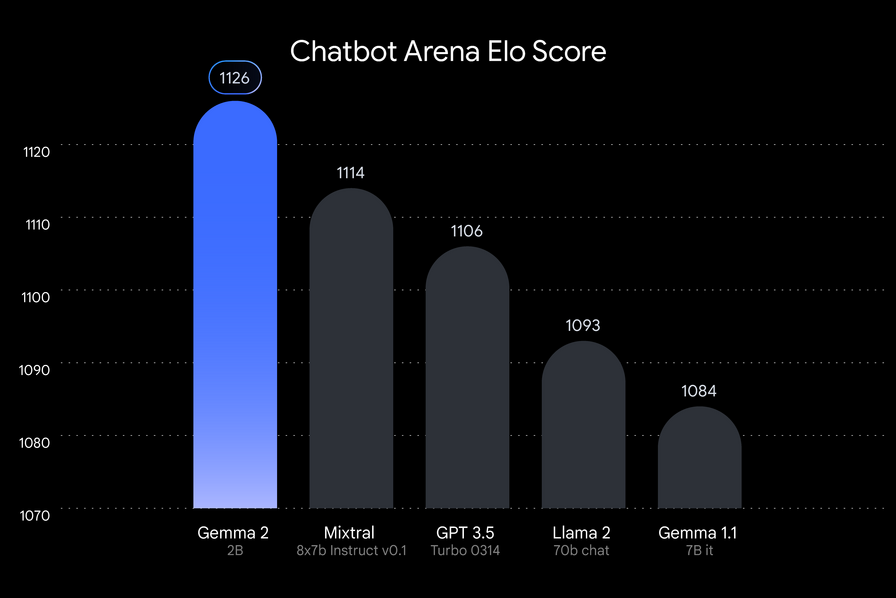

Le 27 juin dernier, Google lançait les premiers modèles Gemma 2 dans des tailles de paramètres de 9 milliards (9B) et 27 milliards (27B), plus performants et plus efficaces en matière d’inférence que la première génération, avec des avancées significatives en matière de sécurité intégrées. Gemma 2 27B est aujourd'hui l’un des modèles les mieux classés dans le classement LMSYS Chatbot Arena, surpassant des modèles deux fois plus grands dans des interactions réelles.Les trois nouveaux ajouts à la famille Gemma 2, renforçant son engagement envers une IA responsable, ont été présentés par Google dans le blog intitulé : "Plus petite, plus sûre, plus transparente : faire progresser l’IA responsable avec Gemma".

Gemma 2 2B : performances de nouvelle génération

Gemma 2 2B, entraîné sur un ensemble de données textuelles comptant 2000 milliards de jetons provenant de documents web, de mathématiques et de code, offre des résultats impressionnants grâce à la distillation de connaissances à partir de modèles plus grands.

Comme on peut le voir ci-dessus, il surpassait le 31 juillet dernier non seulement Gemma 7B, le modèle le plus grand de la génération précédente, mais également Mixtral 8x7B Instruct, les modèles GPT-3.5 et Llama 2 70B sur la plateforme Chatbot Arena. Le système de classement Elo permet de mesurer les performances des LLMs en fonction de leurs interactions les uns avec les autres.

Gemma 2 2B est optimisé pour des déploiements flexibles et rentables. Il peut fonctionner efficacement sur divers matériels, allant des appareils de périphérie aux déploiements cloud robustes via Vertex AI et Google Kubernetes Engine (GKE). En outre, il s'intègre de manière transparente à des outils populaires tels que Keras, JAX, Hugging Face, NVIDIA NeMo, et prochainement à MediaPipe.

Il est possible de télécharger les poids de Gemma 2 sur Kaggle, Hugging Face, Vertex AI Model Garden et de tester ses capacités dans Google AI Studio.

ShieldGemma : des classificateurs de sécurité de pointe

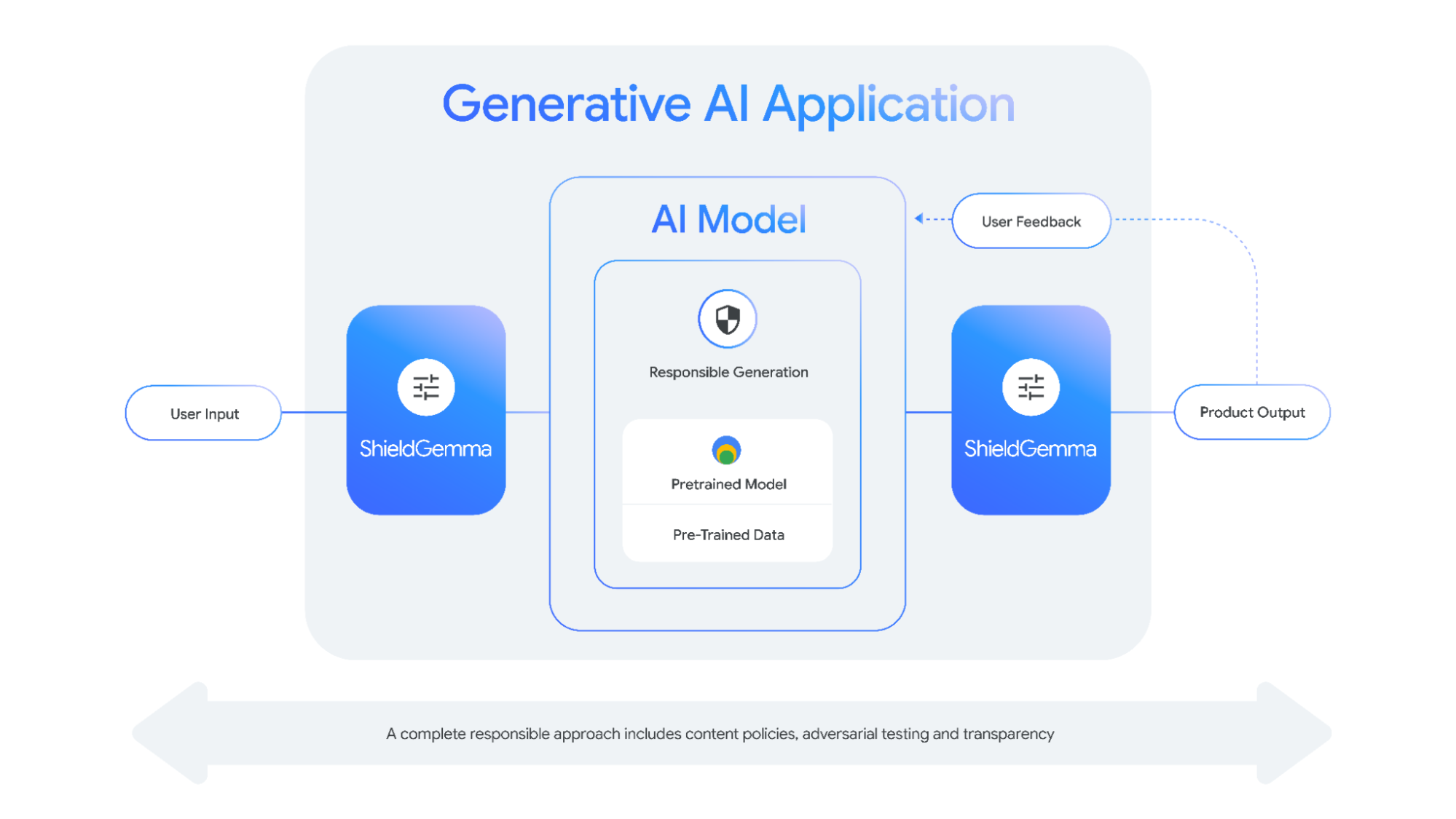

Pour assurer des interactions sûres et inclusives avec l'IA, Google introduit ShieldGemma, une série de classificateurs de sécurité conçus pour détecter et atténuer les contenus nuisibles. Ces classificateurs ciblent quatre domaines principaux : discours de haine, harcèlement, contenu sexuellement explicite et contenu dangereux. Disponible en tailles de modèles variées (2B, 9B, et 27B), ShieldGemma offre des solutions adaptées pour des tâches de classification en ligne et hors ligne.

Explorer ShieldGemma.

Gemma Scope : transparence et interprétabilité

Gemma Scope est un outil qui offre une transparence sans précédent sur les processus décisionnels des modèles d'IA. Utilisant des autoencodeurs épars (SAE), Gemma Scope permet aux chercheurs et développeurs de comprendre en profondeur comment Gemma 2 identifie les motifs, traite les informations et fait des prédictions. Avec plus de 400 SAEs disponibles couvrant toutes les couches des modèles Gemma 2 2B et 9B, Gemma Scope facilite l'exploration interactive des fonctionnalités des modèles sur Neuronpedia, sans nécessiter de code.Essayez Gemma Scope sur Neuronpedia pour explorer le fonctionnement interne de Gemma 2.