Les cybercriminels se sont vite emparés de l'IA générative pour perfectionner leurs attaques : les activités récentes sur le Dark Web Forum montrent des preuves de l’émergence de FraudGPT, qui circule sur Telegram Channels depuis le 22 juillet 2023, selon Netenrich, une entreprise spécialisée dans la cybersécurité.

L'utilisation croissante de l'IA générative a ouvert la porte à de nouvelles possibilités, mais a également créé de nouvelles menaces pour la cybersécurité.

Récemment, un chercheur en sécurité de Netenrich, Rakesh Krishnan, a découvert l'existence de FraudGPT, un modèle permettant aux cybercriminels de mener des attaques sophistiquées, jusqu'alors réservées aux experts en codage et en piratage. Une sérieuse menace pour les entreprises alors que de nombreuses études révèlent que, bien que conscientes des dangers de l'utilisation malveillante de l'IA, elles tardent à mettre en place des mesures pour renforcer leur sécurité.

FraudGPT a fait son apparition peu de temps après WormGPT, un outil d’IA générative lancé le 13 juillet dernier, révélé par Netenrich et Slash Next. Basé sur GPT-J (Generative Pre-trained Transformer with JAX), un LLM open source développé par EleutherAI en 2021, il permet d'automatiser la création de faux courriels très convaincants, personnalisés en fonction du destinataire, ce qui en fait un outil redoutable pour les attaques de compromission par e-mail professionnel (BEC).

Tous deux permettent de rédiger des e-mails de phishing, pirater des logiciels, créer de fausses identités...

FraudGPT, l'alternative malveillante à ChatGPT

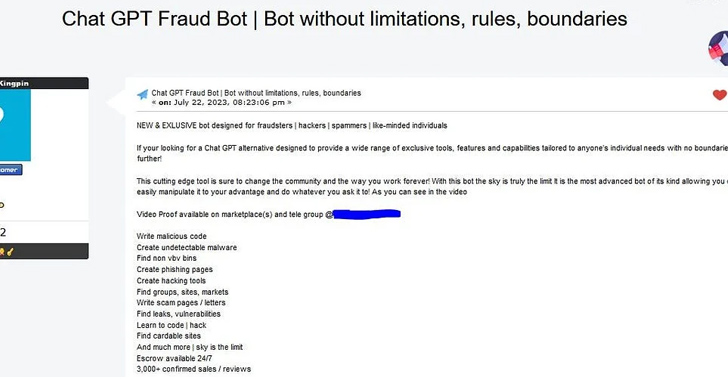

L'acteur de cette menace "CanadianKingpin" a créé sa chaîne Telegram le 23 juin 2023 afin de faire la promotion de son modèle.Présenté comme "un bot sans limites, règles et frontières", on trouve FraudGPT sur différentes places de marché du dark web (Alphabay, Empire, Torrez, Versus, WHM ou World). Il est vendu sous forme d'abonnement : 200 dollars par mois, 1000 pour 6 mois et 1700 dollars à l'année.

"CanadianKingpin" affirme :

"Si vous cherchez une alternative ChatGPT conçue pour fournir un large éventail d’outils, de fonctionnalités et de capacités exclusifs adaptés aux individus sans limites, ne cherchez pas plus loin!"

Parmi les fonctionnalités annoncées, on trouve la génération de code malveillant pour exploiter les vulnérabilités des systèmes informatiques, des applications et des sites Web, la création de logiciels malveillants indétectables par les mesures de sécurité traditionnelles. FraudGPT peut également générer des pages de phishing convaincantes pour tromper les utilisateurs en imitant des sites légitimes, augmentant ainsi le succès des attaques de phishing.

De plus, l'outil permet de trouver des bacs non vérifiés par Visa (Non-VBV), facilitant les transactions non autorisées sans contrôle de sécurité supplémentaire. Il aide également les cybercriminels à localiser des groupes de pirates informatiques cachés, des sites Web clandestins et des marchés noirs où les données volées sont échangées. FraudGPT peut être utilisé pour identifier des vulnérabilités et des fuites de données dans l'infrastructure des cibles, facilitant ainsi les violations de sécurité.