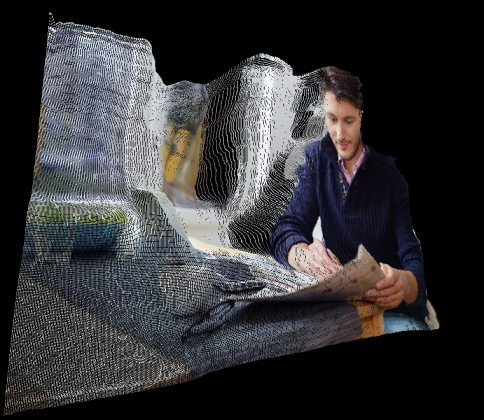

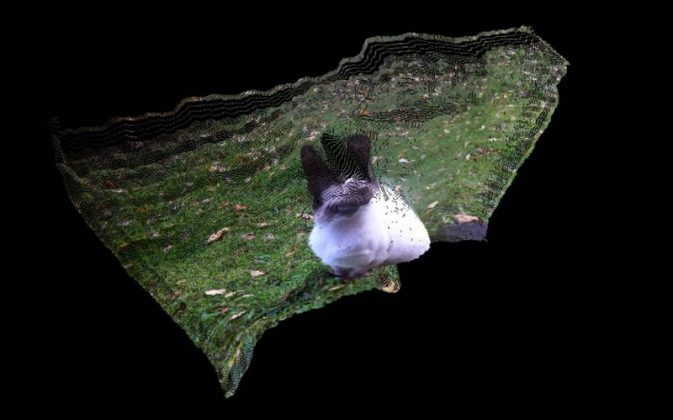

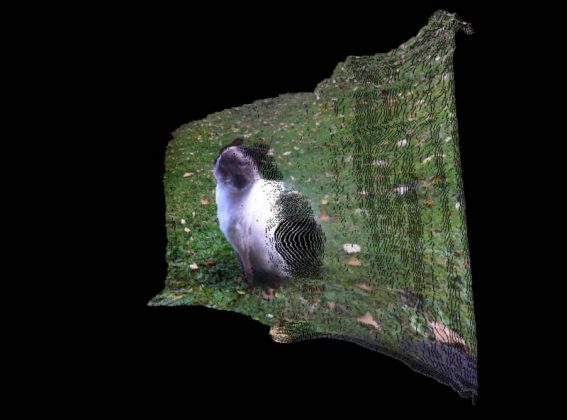

Or Fleisher et Dror Ayalon, deux développeurs spécialisés en intelligence artificielle, ont lancé une expérience interactive IA sur leur site internet Volume.gl. Les internautes ont la possibilité de tester l’API de reconstruction 3D directement depuis leur navigateur et de voir passer leur image (visage, environnement, etc.) 2D en image 3D.

En début d’année, ces deux développeurs s’étaient fait connaître en transformant de manière ingénieuse une webcam des plus basiques en un système de motion tracking (ou match moving) comme nous l’expliquions dans cet article. Sur leur site, nous pouvons désormais découvrir une autre manière d’utiliser les algorithmes et transformer des images en visuels 3D comme l’indique The Next Web, qui s’est entretenu avec Or Fleisher, notamment sur les similitudes entre Volume.gl et d’autres outils permettant de faire passer en 3D des photos de visages tel que celui présenté dans l’article Large Pose 3D Face Reconstruction from a Single Image via Direct Volumetric CNN Régression de Aaron S. Jackson, Adrian Bulat, Vasileios Argyriou et Georgios Tzimiropoulos – Université de Nottingham) :

“C’est différent à certains égards et semblable à d’autres. Alors que les mécanismes de construction et d’entraînement de tels réseaux neuronaux profonds ont des similitudes, notre objectif de créer un modèle qui comprenne le corps humain et les environnements nécessite beaucoup de données…

Nous entraînons quelques modèles pour différentes tâches et développons une méthode de classification pour identifier les éléments dominants dans l’image. Une fois que nous savons à quoi nous attendre, nous sommes en mesure de choisir un modèle qui a une compréhension plus pointue de ce à quoi cela devrait ressembler en 3D.

C’est assez différent des autres approches qui accumulent beaucoup de connaissances dans un seul modèle de machine learning. Il s’agit toujours d’un projet en cours, mais nous espérons continuer à entraîner les réseaux afin d’acquérir davantage de connaissances nécessaires pour reconstruire des visages humains et des environnements 3D à partir d’images et de vidéos 2D.”

Il est possible d’uploader ses propres images afin de visualiser comment l’algorithme va les transformer en images 3D. L’API est encore en développement mais on peut déjà voir comment cela pourrait être utile notamment pour des vidéos ou jeux vidéo.

“Il est important de préciser que nous ne partageons aucune des données téléchargées par les utilisateurs. Nous les utilisons cependant pour évaluer les modèles de machine learning afin de mieux comprendre ce qui fonctionne et ce qui ne fonctionne pas.

Notre objectif avec la mise à disposition de notre API au public, via notre nouveau site internet, est également d’apprendre quelles sont les tendances, les courants et les souhaits des gens pour une telle fonctionnalité. Nous encourageons aussi les utilisateurs à partager leurs reconstructions de volume sur les réseaux sociaux en utilisant l’icône de partage en haut. Nous pensons qu’en montant le travail que nous faisons en interne aux internautes, nous serons en mesure de développer un outil efficace et innovant.”

“Nous regardons également du côté de domaines plus populaires tels que l’augmentation d’image. Nous avons expérimenté et construit une application appelée ReTouch, qui permet l’utilisation de l’estimation de la profondeur pour retoucher les images dans 2.5D, tout a été mis en open source.

Ceci dit, le but de l’API Volume est d’encourager l’utilisation diversifiée de la même technologie dans différents domaines et pour différentes utilisations. En construisant Volume comme un cloud, API de vision par ordinateur, nous sommes en mesure de fournir les mêmes résultats que nous utilisons pour la reconstruction 3D pour des personnes qui ne l’utilisent pas nécessairement avec le même but”.

L’API Volume est disponible sur ce site.