Les Etats membres de l'UE ont adopté l'AI Act le 2 février dernier, confirmant l'accord provisoire obtenu en décembre dernier. Les premières obligations l'accompagnant seront effectives dans les 6 mois suivant sa publication au Journal officiel de l’UE, après un dernier vote au Parlement européen. France Digitale, Wavestone et Gide publient un guide pratique à l'intention des entreprises de toutes tailles, leur permettant de comprendre rapidement les enjeux de cette nouvelle réglementation et d'anticiper les prochaines étapes de la mise en conformité de leurs systèmes d’IA.

L’AI Act vise à garantir que les systèmes et modèles d'IA commercialisés au sein de l’UE soient utilisés de manière éthique, sûre et respectueuse des droits fondamentaux de l’UE.

L'AI Act impose des obligations et des restrictions aux fournisseurs et aux utilisateurs qui développent, déploient ou exploitent des systèmes et des modèles d’IA au sein de l'UE. Bien qu'il soit désormais prévu de réviser régulièrement ces obligations, aujourd'hui, une réglementation produit, allant du marquage CE à l’interdiction de mise sur le marché, est appliquée à ces derniers suivant leur niveau de risque, des dispositions particulières sont prévues pour les entreprises qui développent des modèles d’IA génératives.

- les systèmes d’IA présentant un risque inacceptable vont être interdits de mise sur le marché ;

- les systèmes d’IA présentant un haut risque devront obtenir un marquage CE;

- les systèmes d’IA à risque faible ou minime doivent intégrer des obligations d’information des utilisateurs ou suivre un code de conduite volontaire.

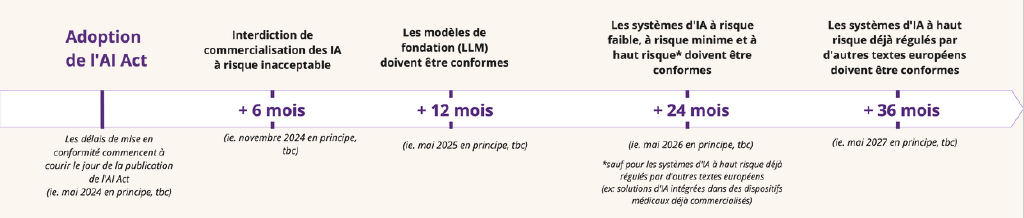

"Cette décision a un goût doux amer. Si l’AI Act répond à un enjeu majeur en matière de transparence et d’éthique, il crée néanmoins des obligations conséquentes pour toutes les entreprises qui utilisent ou développent de l’intelligence artificielle, malgré quelques aménagements prévus pour les startups et PME notamment au travers de bacs à sable réglementaires. Nous craignons que le texte ne fasse que créer des barrières réglementaires supplémentaires qui profiteront à la concurrence américaine et chinoise et réduiront l’opportunité de faire émerger des champions européens de l’IA”. L’AI Act va entrer en vigueur progressivement selon le niveau de risque des systèmes ou modèles d’IA, les entreprises auront de 6 à 36 mois pour se mettre en conformité comme on peut le voir dans la frise ci-dessous :

Mais pour les auteurs du guide, si ce calendrier progressif a été pensé par le régulateur pour laisser le temps aux entreprises de se mettre en conformité, il est important d’anticiper les différentes étapes à venir dès à présent.

Chadi Hantouche, Partner chez Wavestone, un cabinet de conseil français, explique :

“Pour réussir cette mise en conformité, les entreprises vont devoir réaliser des tests, fournir la documentation requise, interagir avec la gouvernance prévue et suivre le processus de mise en conformité dans la durée. 3 conseils pour y arriver sereinement : suivre la méthode par étapes que nous proposons dans le guide, constituer une équipe dédiée et anticiper l'impact budgétaire pour votre entreprise.” Le non-respect du règlement expose les fournisseurs et les utilisateurs à des risques juridiques et financiers. Le règlement prévoit en effet des sanctions administratives, civiles et pénales, qui peuvent aller jusqu’à 7% du chiffre d’affaires annuel mondial ou 35 millions d’euros, pour les infractions les plus graves, comme la mise sur le marché ou l’utilisation d’IA interdites.

Comment tester l'IA avant sa mise sur le marché ou en service ?

L’AI Act prévoit une obligation pour chaque autorité nationale de mettre en place un bac à sable réglementaire.Ces bacs à sables doivent être opérationnels au moment de l’entrée en application de l’AI Act, en 2026. Ils permettront aux entreprises de tester les systèmes d’IA avant leur mise sur le marché ou en service, afin de favoriser l’innovation et le développement de l’IA en Europe.

Des tests en vie réelle sont également prévus par l'AI Act, ces expérimentations pourront être menées par les fournisseurs d’IA, avec le consentement des utilisateurs et des autorités nationales concernés, tout en respectant certaines conditions de sécurité, de transparence et de supervision.

Julien Guinot-Deléry, Associé, et Matthieu Lucchesi, Counsel chez Gide, concluent :

“L’application de l’AI Act va arriver très vite. Les opportunités mais aussi les défis que pose ce nouveau règlement sont significatifs et touchent un panel d’acteurs et d’industries très large. Il est essentiel que les entreprises se préparent dès maintenant et anticipent la mise en conformité de leurs systèmes d’IA, en tenant compte d’autres réglementations, dont celles sur le droit d’auteur". Découvrir le guide ici